BP를 이용한 문자 학습 및 인식

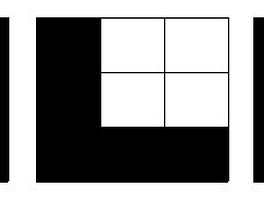

부제 : BP를 이용한 ㄱ, ㄴ, ㄷ 학습 및 인식 이전 글에 이어, 알고리즘을 수정하고 BPNET 클래스를 만들어서 테스트. 주요 추가/수정 내용으로, 1) 초기 연결 강도를 자동으로 설정 2) 일반 BP 학습법과 모멘텀 BP 알고리즘 선택 가능 3) 출력값이 1차원이던 것을 다차원 가능한 형태로 수정 4) 기타 잡다한 버그 수정 수정된 BP 알고리즘을 이용하여, 아래 그림의 문자들을 학습 입력벡터 : x1 = { 1, 1, 1, 0, 0, 1, 0, 0, 1} x2 = { 1, 0, 0, 1, 0, 0, 1, 1, 1} x3 = { 1, 1, 1, 1, 0, 0, 1, 1, 1} 목표 : t1 = { 0, 0 } t2 = { 0, 1 } t3 = { 1, 0 } 학습결과 아래와 같이 연결강도가 변경됨..

BP를 이용한 문자 학습 및 인식

부제 : BP를 이용한 ㄱ, ㄴ, ㄷ 학습 및 인식 이전 글에 이어, 알고리즘을 수정하고 BPNET 클래스를 만들어서 테스트. 주요 추가/수정 내용으로, 1) 초기 연결 강도를 자동으로 설정 2) 일반 BP 학습법과 모멘텀 BP 알고리즘 선택 가능 3) 출력값이 1차원이던 것을 다차원 가능한 형태로 수정 4) 기타 잡다한 버그 수정 수정된 BP 알고리즘을 이용하여, 아래 그림의 문자들을 학습 입력벡터 : x1 = { 1, 1, 1, 0, 0, 1, 0, 0, 1} x2 = { 1, 0, 0, 1, 0, 0, 1, 1, 1} x3 = { 1, 1, 1, 1, 0, 0, 1, 1, 1} 목표 : t1 = { 0, 0 } t2 = { 0, 1 } t3 = { 1, 0 } 학습결과 아래와 같이 연결강도가 변경됨..